Lectura 6:00 min

Por elecciones, abundarán deepfakes políticos, advierte Brita IA

El proceso electoral que está por comenzar en México será el inicio de una proliferación de videos o audios creados vía inteligencias artificiales con motivos manipulatorios, señala el especialista Néstor Wario, por lo que advierte que son necesarias regulaciones no sólo locales sino globales.

Advierten de riesgos de la IA, para manipulación de información en el proceso electoral. Foto: Shutterstock

Se le llama deepfake a aquel contenido principalmente audiovisual en el que es posible observar el rostro de una persona y/o escuchar su voz emitiendo contenidos falsos, es decir que la persona que aparece en este contenido no efectuó y pudo no haber autorizado su difusión.

Estas deepfakes, como las que usted seguramente se habrá encontrado en repetidas ocasiones a través de las redes sociales, son posibles por el desarrollo de las tecnologías de inteligencia artificial basadas en machine learning, es decir, a partir de algoritmos de redes neuronales, un tipo de tecnología artificial desarrollada con base de la estructura y funcionamiento del cerebro humano cuya investigación y desarrollo se remonta a más de un siglo atrás, pero que hoy en día vive un pináculo de desarrollo al que es necesario prestar atención.

A muy grandes rasgos, las redes neuronales generativas antagónicas (GAN’s por su sigla en inglés) funcionan como dos partes contrapuestas en un juego tan sencillo como “Frío y caliente”, sólo que con partidas a velocidades imposibles de asimilar para el ser humano.

Una de estas redes es nombrada generativa, mientras que la otra es la discriminadora. La primera de éstas tiene la tarea de generar imágenes lo más verosímiles posibles sobre una tarea en específico, por ejemplo, un rostro humano; mientras que la segunda se encargará de verificar cada una de estas imágenes –o videos– para descartar todas las que no empaten con los parámetros aprendidos de manera automática sobre la forma y flexiones naturales de un rostro humano. Este cotejo se puede prolongar por millones de oportunidades hasta que, finalmente, la IA generativa haya sido capaz de aprender los parámetros que su contraparte acepta y rechaza para finalmente entregar un resultado convincente, que la IA verificadora no pueda descartar por su alto grado de realismo.

IA’s y los riesgos de su uso político

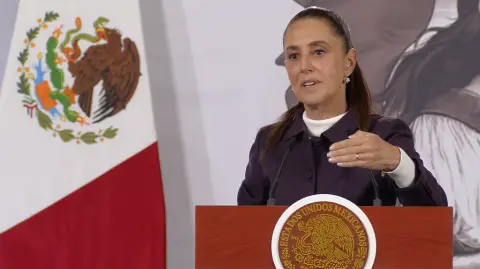

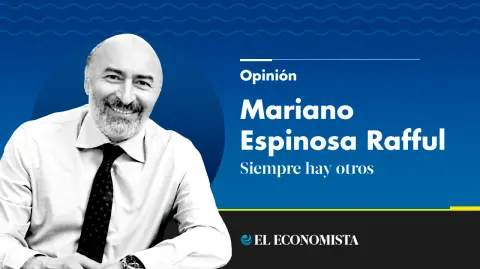

En México, el 9 de septiembre pasado inició el proceso electoral federal que culminará con el ejercicio ciudadano del 2 de junio de 2024, en el que se resolverá no sólo la presidencia de la República sino nueve gubernaturas, el gobierno de la Ciudad de México, 128 senadurías y 500 diputaciones federales. En este proceso, advierte Néstor Wario, CEO y cofundador de la empresa mexicana Brita Inteligencia Artificial y especialista en la aplicación de las IA’s en marketing y política, la sociedad mexicana es vulnerable ante una probable proliferación de contenidos políticos falsos producto de redes generativas antagónicas.

(INSERT FOTO 2 Néstor Wario, CEO y cofundador de la empresa mexicana Brita Inteligencia Artificial. Cortesía)

“En internet ya hay plataformas para el desarrollo de deepfakes, donde cualquier persona puede suplantar la identidad de alguien cambiando su rostro. Esto podría generar información falsa o fake news para confundir a la población, más aún en los tiempos electorales en México. Se podría utilizar para manipular la opinión pública, como ya se ha utilizado en otros países. Vamos a empezar a ver imágenes o videos de supuestos políticos en situaciones comprometedoras o audios manipulados con el mismo fin”, indica el especialista.

Pero el anticipo del CEO de Brita no es un caso aislado. En agosto pasado, la UNESCO lanzó desde México una advertencia similar sobre el crecimiento exponencial de la recabación de datos neuronales por los países y las trasnacionales que más invierten en el desarrollo de neurotecnologías e IA’s. En aquella conferencia, entre otros temas, la UNESCO señaló: “la manipulación puede llevarnos a una pérdida de control en temas como la identidad personal y la libertad de pensamiento”.

Y es que los casos de manipulación política por deepfakes en otras naciones tienen ya un amplio registro. Uno de los ejemplos más claros es la aparición en 2019 de un video con el rostro y la voz de expresidente estadounidense Barack Obama diciendo: “el presidente Trump es un total y completo idiota”. Sin embargo, este video precisamente fue parte de una campaña de advertencia, cuyo actor base fue el director de cine Jordan Peele, para evidenciar lo fácil que es generar contenidos audiovisuales falsos para perfilar fines políticos específicos. Dicho video es fácil de encontrar en internet con las palabras clave “fake Obama”.

Las legislaciones locales no bastan

Hacer deepfakes, reitera el entrevistado, “ahora es mucho muy fácil. Antes teníamos que hacerlo por medio de código, pero ahora con la IA generativa solamente hay que darle el input por escrito, con indicaciones de tono. La tecnología te va a dar el resultado y esto todavía lo puedes mejorar en el editor”.

Por todo esto, admite, en países como México vamos tarde en temas de regulación. “A finales de este año Europa ya va a sacar sus primeras regulaciones. Estados Unidos también está trabajando muy en serio con el tema. En México sí es muy importante que se empiece a regular, es relevante que el Gobierno se involucre todavía más, porque en el país lamentablemente ha habido iniciativas aisladas. Nosotros hemos levantado la voz y nos hemos acercado al Legislativo, pero no ha sido un tema de interés por el momento. Es importante que los tomadores de decisiones volteen a ver estas tecnologías porque pueden ser una amenaza pública si no se cuenta con regulaciones que respalden a la sociedad”.

Ahora bien, precisa, dado que las IA’s generativas habitan un campo tecnológico y es muy fácil que una persona, bien o mal intencionada, pueda cambiar su IP sin mayor cortapisa para seguir trabajando en un territorio sin regulaciones, la respuesta más adecuada y urgente es la homologación de acuerdos políticos internacionales.

“Cualquier persona puede hacerse de una plataforma tecnológica que le permita desubicarse geográficamente. Una regulación global ayudaría a evitar este tipo de casos. El asunto es reducir toda posibilidad de manipulación de información para fines malintencionados en Europa, en América o en cualquier territorio. Por eso es imprescindible el impulso de iniciativas globales”, concluye.